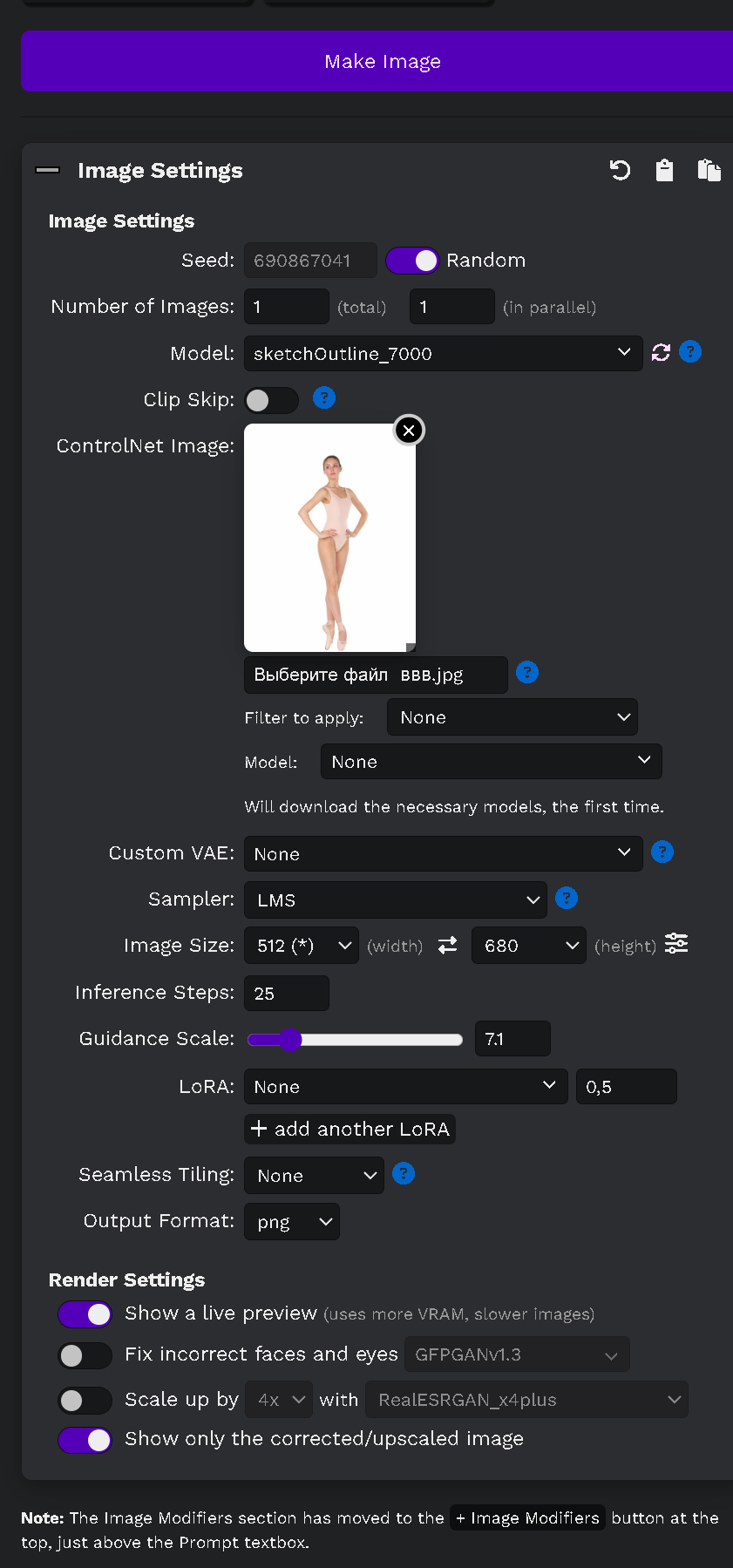

Наконец собрался с силами и решил написать подобие инструкции к работе над картинками в нейросетях. За основу беру то, что знаю - Stable Diffusion online и Easy Diffusion (десктопная, то есть, можно установить на компьютер и не зависеть от сервисов и интернета). Easy Diffusion в отличие от многих других не требует обязательно НВИДИА карты с CUDA (устанавливается в настройках программы).

По сути это одна программа сети,только разные оболочки. В интернете можно найти другие сервисы и десктопные приложения на этой платформе этой нейросети.

Сегодня рассмотрим то, что называется запросами (prompt,промпт). Это относится ко всем сетям, в том числе на других платформах, например midjourney. Отличия могут быть, однако, микроскопичные.

PROMPT (запросы)

Теперь о приемах с весами запросов.

Если же вы хотите самостоятельно выставить вес, то используйте конструкцию «:хх», где хх — числовое значения веса.

Например: Angry dragon:60 flies over medieval castle:40. (злой дракон летит над средневековым замком)

В сумме, все веса должны давать 100.

Создавая запрос для генерации помните, что общаетесь с написанным программистами кодом. Если вы хотите получить более предсказуемый результат, формулируйте запрос, указывая точные объекты, места и свойства изображаемого. Обратите внимание, что длина фразы не должна быть больше 75 слов. Диффужен в отличии от Миджурни любит длинные описания.

Составляя фразу для генерации, с помощью специальных операторов вы можете расставить определенные акценты на тех или иных словах и фразах. Делается это с помощью следующих конструкций:

Теперь о том, почему наши запросы не всегда учитываются или частично.

Все нейросети обучаются на моделях. В данном случае, если грубо, это набор картинок.

Если модель состоит из набора голых девиц, то не ждите, что сети, обученные на ней, дадут вам великолепную одежду на девушке. Надо дополнительно использовать обучение на картинках, где много одежды. И так далее. Причем, если одежда казуал, то при же запросе "высокая мода", что вы именно это и получите, если только фантазийную из бытовой одежды или ту же бытовую повседневную.

На десктопном варианте вы можете использовать разные модели и даже создавать свои (но тут не все просто и сейчас не буду об этом).

Укажу сайт, где обычные пользователи публикуют свои модели. В Easy Diffusion (десктопной) можно их объединять и смешивать. Можно подобрать модель с девушками или с мужчинами, которые нравятся, и и соединить с моделями, где одежда или другие предметы или архитектура с природой. Таким образом мы создадим нужную себе модель на определенную тему и в работе использовать ее. В запросе мы должны указать слова-триггеры, которые подскажут сетям, что мы хотим от них. Но, к сожалению, о таких словах чаще всего мы можем только догадываться или искать опытным путем.

Смотрим модели для десктопной версии и скачиваем

Есть несколько версий модели. Одни обучались на 512 на 512 пикселей (размер картинок) , другие на 768х768 пикселях.

Продолжение далее...

По сути это одна программа сети,только разные оболочки. В интернете можно найти другие сервисы и десктопные приложения на этой платформе этой нейросети.

Сегодня рассмотрим то, что называется запросами (prompt,промпт). Это относится ко всем сетям, в том числе на других платформах, например midjourney. Отличия могут быть, однако, микроскопичные.

PROMPT (запросы)

Двойные скобки увеличат вес (акцентируют внимание) еще в два раза. Тоже с квадратными (двойные) уменьшат вес в два раза больше чем одинарные.это набор инструкций в виде текста, данных алгоритму машинного обучения, который используется для создания определенного вывода. Пользователь пишет «подсказку» в специальном окне программы, например: предмет его цвет и стиль изображения, и ИИ создаёт картинку на основе этой подсказки.

Правильное написание подсказок, является одним из ключевых элементов получения желаемого изображения. Написание подсказок требует отдельной статьи с подробными примерами, но основные правила такие:

- на любой текст что вы вводите в программу она реагирует, даже на не верный (отсутствующий в базе), по этому будьте внимательны при составлении запроса, возможно часть слов которые должны улучшить результат - не работают должным образом.

- обычно хорошая подсказка должна содержать существительное, прилагательное и глагол, чтобы создать интересную тему. Но это не обязательное условие.

- имейте в виду, что порядок написания слов имеет значение. Слова в начале подсказки имеют больший «вес», чем слова в конце подсказки.

- «вес» слов можно регулировать, кроме перестановки в начало строки, в различных версиях программы есть различные приёмы для изменения «веса», например слово «cat» будет слабее слова «(cat)» и сильнее слова«[cat]», как вы догадались, всё дело в скобках в которые заключено слово или несколько слов.

Теперь о приемах с весами запросов.

Если же вы хотите самостоятельно выставить вес, то используйте конструкцию «:хх», где хх — числовое значения веса.

Например: Angry dragon:60 flies over medieval castle:40. (злой дракон летит над средневековым замком)

В сумме, все веса должны давать 100.

Создавая запрос для генерации помните, что общаетесь с написанным программистами кодом. Если вы хотите получить более предсказуемый результат, формулируйте запрос, указывая точные объекты, места и свойства изображаемого. Обратите внимание, что длина фразы не должна быть больше 75 слов. Диффужен в отличии от Миджурни любит длинные описания.

Составляя фразу для генерации, с помощью специальных операторов вы можете расставить определенные акценты на тех или иных словах и фразах. Делается это с помощью следующих конструкций:

- Контроль внимания поподробнее в спойлере:

() — увеличение акцента

[] — уменьшение акцента

Увеличение акцента будет означать, что вложенные слова и фразы будут в большей степени влиять на сгенерированное изображение. Уменьшение акцента произведет обратное действие: вложенные слова и фразы будут в меньшей степени влиять на сгенерированное изображение.

Контроль внимания или расстановка акцентов будет работать как в стандартных фразах для генерации так и отрицательных.

— (слово или фраза) — увеличивает акцент в качестве фактора 1.1

— ((слово или фраза)) — увеличивает акцент в качестве фактора 1.21 (= 1.1 * 1.1)

— [слово или фраза] — уменьшает акцент на фактор 1.1

— (слово или фраза:1.5) — увеличивает акцент в качестве фактора 1.5

— (слово или фраза:0.25) — уменьшает акцент на фактор 4 (= 1 / 0.25)

Теперь о том, почему наши запросы не всегда учитываются или частично.

Все нейросети обучаются на моделях. В данном случае, если грубо, это набор картинок.

Если модель состоит из набора голых девиц, то не ждите, что сети, обученные на ней, дадут вам великолепную одежду на девушке. Надо дополнительно использовать обучение на картинках, где много одежды. И так далее. Причем, если одежда казуал, то при же запросе "высокая мода", что вы именно это и получите, если только фантазийную из бытовой одежды или ту же бытовую повседневную.

На десктопном варианте вы можете использовать разные модели и даже создавать свои (но тут не все просто и сейчас не буду об этом).

Укажу сайт, где обычные пользователи публикуют свои модели. В Easy Diffusion (десктопной) можно их объединять и смешивать. Можно подобрать модель с девушками или с мужчинами, которые нравятся, и и соединить с моделями, где одежда или другие предметы или архитектура с природой. Таким образом мы создадим нужную себе модель на определенную тему и в работе использовать ее. В запросе мы должны указать слова-триггеры, которые подскажут сетям, что мы хотим от них. Но, к сожалению, о таких словах чаще всего мы можем только догадываться или искать опытным путем.

Смотрим модели для десктопной версии и скачиваем

Есть несколько версий модели. Одни обучались на 512 на 512 пикселей (размер картинок) , другие на 768х768 пикселях.

Продолжение далее...

автор почемучка Пт 14 Июл 2023 - 14:03

автор почемучка Пт 14 Июл 2023 - 14:03

Как только семья отпустит с дачи и огорода... Думаю, через неделю смогу освободиться для этого.

Как только семья отпустит с дачи и огорода... Думаю, через неделю смогу освободиться для этого.